2026年的春天,科技圈的目光再次聚焦于小米。时隔四年,在万众期待中,小米在4月27日的投资者日活动上,揭开了其新款人形机器人的神秘面纱。现场,这款机器人能够与参会者亲切互动,轻松地递上纸袋,俏皮地做出“比心”手势,其灵巧与亲和力让不少在场的人眼前一亮。

不过,如果只被这些“卖萌”动作吸引,恐怕会错过小米真正的底牌。

▍从“比心”到进厂“打工”,小米机器人四年磨一剑

回看2022年8月,小米第一代人形机器人CyberOne发布时也曾引发热议。但随后很长一段时间里,小米在人形机器人领域几乎“静音”——这不是停滞,而是一场漫长的积累。

这次的新款机器人,外观上延续了CyberOne的暗灰色调和小米标志,但真正的进化藏在手上。现场演示的“比心”、分发纸袋等动作,看起来简单,背后却是一套基于触觉抓取的微调模型,让机器人拥有了更精细的物理交互能力。

今年3月,雷军对外透露,小米的机器人已经悄悄进了自家的汽车工厂“上班”——不是做样子,而是真的在产线上干活,比如搬运料箱、给自攻螺母上件等。

小米集团合伙人、总裁、手机部总裁卢伟冰在不久前对此进行了解读,小米在机器人方向已经投入了五六年,这次能真正进厂干活,靠的是大模型上的突破。

他点出了两项核心支撑:一是前面提到的灵巧手(基于触觉抓取的微调模型),另一个就是VLA大模型Xiaomi-Robotics-0。根据卢伟冰透露,“这台机器人进厂打螺丝,能够自主运行3小时,安装成功率超过了90%,并满足产线76秒最快节拍的要求。”

当时,卢伟冰也强调,机器人刚刚进入工厂,离大规模应用还需时间。今年大家会在不同阶段看到机器人方面的一些成果展示。

▍20小时速成精细活:Xiaomi-Robotics-0的“丝滑”之道

Xiaomi-Robotics-0是小米在2026年2月发布的VLA(视觉-语言-动作)模型,参数规模4.7B,专门解决机器人在真实作业中容易出现的推理延迟、动作卡顿、能力遗忘等问题。发布首月,它就在HuggingFace全球VLA模型下载榜上冲到了第六名。

为了展示这套模型的真实能力,小米设计了一个相当“刁钻”的测试任务:让机器人把耳机塞回耳机盒。

听起来简单,但对机器人来说挑战不小——耳机和槽位的尺寸几乎严丝合缝,任何微小偏差都会导致对不准,这意味着模型必须具备亚毫米级的空间判断力。更麻烦的是,耳机和盒子表面都极其光滑(表面粗糙度低至Ra0.03μm),轻轻一碰就容易滑偏,模型得在操作过程中不断自我修正,否则根本放不进去。

而Xiaomi-Robotics-0仅需20小时任务数据,就能让机器人拿下这个高难度动作,还能连续、丝滑地完成多组耳机的收纳。

20小时速成的背后,是基于小米预先构建的庞大预训练模型,它包含了约2亿步的机器人运动轨迹数据和超过8000万条的视觉及语言样本。真机后训练(Post-training)的作用,就是在这基础上,用少量真实机器人操作数据进行针对性微调,打通模型走向实际应用的“最后一公里”。

多视角展示装配细节

▍开源独门绝技:小米如何攻克机器人“偷懒效应”

在通往机器人动作“丝滑连贯”的道路上,一个行业通病始终是绕不开的拦路虎——“偷懒效应”。而小米此次开源的核心,正是其攻克这一顽疾的“独门绝技”。

为了让机器人的动作看起来无缝衔接,而不是一顿一顿的机械式操作,小米团队工程师采用了异步推理(Asynchronous Execution)方案,即让机器人在执行当前动作时,就同步开始推理下一步的动作。同时,为了保证前后两个动作能够平滑过渡,引入了动作前缀(Action Prefixing)技术,让新动作基于已有动作轨迹 “生长”出来,就像接力赛选手在接棒前需要一段助跑区一样。

然而,这套组合拳带来了一个行业通病:模型变得“懒惰”了。它发现,只要顺着已有的动作惯性去预测,就能轻松完成任务,从而过度依赖动作惯性,而选择性地忽视了实时视觉反馈。

为了根治这种“偷懒效应”,小米团队独创性地引入了三项关键技术:

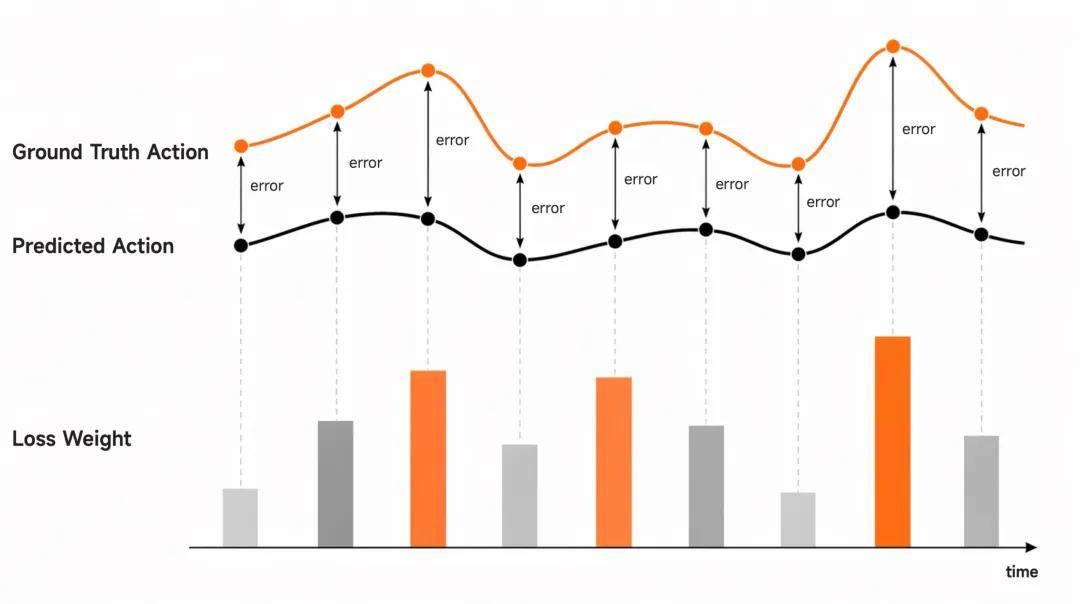

自适应加权机制 (Adaptive Loss Re-weighting):根据模型预测值与真实轨迹的偏差,动态调整 Loss 权重,引导模型针对性地修正关键误差、补齐能力短板。

自适应加权机制 (Adaptive Loss Re-weighting)

Λ型掩码 (Λ-Shape Attention Mask):通过特殊的注意力机制,确保模型在参考前段动作末尾的同时,保持对当前视觉信号的高度专注,防止陷入单纯的“路径依赖”。

Λ 型掩码 (Λ-Shape Attention Mask)

前缀动作随机遮蔽 (Random Masking):在训练中对既有的动作前缀进行随机 Dropout,倒逼模型深入挖掘摄像头画面与传感器信号,而非盲目跟从动作惯性。

前缀动作随机遮蔽 (Random Masking)

小米已经将包含这三大核心技术在内的整套真机后训练流程——从数据处理、训练方法到推理代码全面开放。这意味着,全球的开发者都可以利用Xiaomi-Robotics-0这个基座,以及这套被验证行之有效的“反偷懒”方法论,以极低的成本,在各种场景下训练出属于自己的“专属机器人”。

▍结语

时隔四年,小米重回牌桌,但江湖已不是那个江湖。赛道上,不仅有特斯拉Optimus、Figure AI的持续进化,更有国内众多新锐的强势崛起。行业的评判标准也早已从“技术炫技”转向“价值肉搏”,比的不再是谁先走上舞台,而是谁能创价值、跑通商业闭环。

在此背景下,小米将核心的“反偷懒”技术开源,这步棋比单纯发布一款新机器人更具深意。用开放换生态,用标准搏未来。这或许既是小米“先学习、再超越”打法的延续,也是在激烈竞争中,为自己争取“换道超车”可能性的关键一搏。

当越来越多的巨头携制造经验和资本涌入,小米的开源为这场竞赛注入了催化剂。一个机器人不再“偷懒”,且人人皆可参与创造的时代,或许正被加速推开大门。

(更多人形机器人赛道深度文章,请关注微信公众号“人形大讲堂”)